Kubernetes 1.36: O Que Realmente Mudou para Plataformas Corporativas

A versão do Kubernetes 1.36 inclui dezenas de aprimoramentos, atualizações e depreciações. Mas para a maioria das equipes corporativas, os detalhes de cada recurso individual não são a parte mais importante. O que importa mais é a direção para a qual essas mudanças apontam e o que isso significa para a evolução do Kubernetes como plataforma.

Kubernetes Está Se Tornando o Plano de Controle para Infraestrutura de IA

Um dos sinais mais claros na versão 1.36 é o investimento contínuo em como o Kubernetes lida com hardware especializado, particularmente GPUs. Trabalhos como o Dynamic Resource Allocation (DRA) vão além da melhoria do agendamento; eles refletem uma mudança mais ampla em direção à padronização de como o Kubernetes interage com recursos de alto valor e limitados.

Um avanço fundamental na versão 1.36 é a introdução de Structured Parameters para DRA. Anteriormente, a solicitação de recursos complexos frequentemente exigia "blobs" opacos e específicos do fornecedor, que eram difíceis para o agendador otimizar. Ao adotar uma abordagem mais estruturada, o Kubernetes está facilitando para o agendador "entender" os requisitos específicos de uma GPU ou acelerador de IA — reduzindo drasticamente a complexidade de implantações de IA multi-nó.

Essa mudança é importante porque as cargas de trabalho de IA se comportam de maneira muito diferente das aplicações tradicionais. Diferente dos serviços web padrão que seguem padrões previsíveis de solicitação-resposta, as cargas de trabalho de IA são frequentemente probabilísticas e computacionalmente "intermitentes". Elas envolvem diferentes conjuntos de entradas e saídas que exigem demandas massivas e paralelas de infraestrutura; falhar em posicionar um pod corretamente não causa apenas uma resposta lenta; pode paralisar um trabalho de treinamento multi-nó inteiro.

Além disso, a IA introduz uma dependência muito maior da gravidade dos dados. Essas cargas de trabalho exigem acesso de alta velocidade a conjuntos de dados massivos e atualizações constantes dessas fontes, tornando a localidade dos dados e a taxa de transferência da rede tão críticas quanto o poder de CPU bruto. Finalmente, enquanto um aplicativo tradicional pode permanecer "estático" uma vez implantado, os modelos de IA exigem monitoramento constante para desvio e ciclos frequentes de retreinamento. Isso significa que a plataforma deve tratar a carga de trabalho não como uma implantação única, mas como um ciclo de vida contínuo e com uso intensivo de recursos que exige um controle muito mais rigoroso sobre o desempenho e o isolamento.

Essa transição é significativa porque introduz nova complexidade. Perguntas sobre compartilhamento de GPU, posicionamento de carga de trabalho e consistência entre ambientes não têm respostas simples. Elas se estendem além do próprio Kubernetes e para o design da plataforma que o cerca. É aqui que estamos vendo um foco crescente em como as plataformas integram controles de nível de infraestrutura com o agendamento nativo do Kubernetes. Em ambientes como VMware Cloud Foundation (VCF) com VMware vSphere Kubernetes Service (VKS), isso significa alinhar capacidades upstream como DRA com controles subjacentes de posicionamento, isolamento e ciclo de vida para que essas cargas de trabalho possam ser gerenciadas de forma consistente, não apenas agendadas com sucesso. E à medida que o Kubernetes assume um papel mais central na execução de cargas de trabalho complexas, também aumenta a importância de como esses ambientes são configurados e protegidos.

Segurança Não É Mais Uma Escolha

O Kubernetes continua a apertar as expectativas de segurança, reforçando que a flexibilidade sem guardrails não é mais aceitável para ambientes de produção. Os padrões estão se tornando mais seguros, as tolerâncias para configurações incorretas estão diminuindo, e a expectativa é que os clusters sejam seguros por design e não por acaso.

Vemos isso claramente na versão 1.36 com a remoção final das anotações legadas do AppArmor em favor do campo formal appArmorProfile. É uma mudança de metadados "hacky" para suporte de API de primeira classe. Da mesma mesma forma, a graduação de User Namespaces para um estado mais estável fornece uma camada crítica de isolamento, garantindo que, mesmo que um contêiner seja comprometido, o "root" dentro do contêiner não se traduza em "root" no host.

Para as equipes corporativas, isso cria uma tensão familiar. O Kubernetes ainda é incrivelmente flexível, mas o custo dessa flexibilidade está aumentando. Quanto mais configurável um sistema é, mais fácil é cair em estados inseguros, a menos que essas configurações sejam ativamente gerenciadas. É por isso que a segurança está cada vez mais saindo da "configuração de cluster" e entrando na "responsabilidade da plataforma". Descobrimos que a implementação desses padrões de segurança upstream dentro de uma plataforma como o VKS reduz a variabilidade. Em vez de depender de equipes para configurar a segurança corretamente a cada vez, plataformas como o VKS se concentram em incorporar essas expectativas em como os clusters são provisionados e operados desde o início para reduzir a variabilidade e melhorar a postura geral. E à medida que essas expectativas se tornam mais incorporadas ao próprio Kubernetes, elas também aumentam a carga operacional de manter os ambientes alinhados com as mudanças upstream.

A Velocidade de Lançamento Está Se Tornando um Problema Operacional

O Kubernetes continua a se mover rapidamente, e isso é parte do que torna o ecossistema tão poderoso. Mas também introduz desafios para as equipes corporativas. Cada lançamento traz novas capacidades, APIs em evolução e a depreciação de comportamentos mais antigos. Nada disso é surpreendente isoladamente, mas juntos, cria pressão para as equipes que tentam manter a estabilidade ao longo do tempo.

Neste ponto, acompanhar o Kubernetes não é mais apenas sobre atualizar clusters. É sobre gerenciar a complexidade do ciclo de vida, decidir quando adotar novas versões, entender como as mudanças impactam as cargas de trabalho existentes e evitar interrupções à medida que a plataforma evolui. Para muitas organizações, isso significa encontrar maneiras de separar a inovação upstream da estabilidade da produção, em vez de tentar mantê-las perfeitamente sincronizadas.

É aqui que modelos de ciclo de vida mais flexíveis se tornam críticos. Com o VKS, por exemplo, lançamentos assíncronos e opções de suporte estendido são projetados para dar às equipes controle sobre como e quando elas adotam as mudanças. Isso permite que elas permaneçam alinhadas com o Kubernetes upstream sem serem forçadas a atualizações constantes. Essa abordagem, em última análise, reforça uma mudança mais ampla: o Kubernetes não é mais algo que você simplesmente implanta, mas é algo que precisa ser continuamente gerenciado como uma plataforma.

Kubernetes Está Se Tornando uma Plataforma

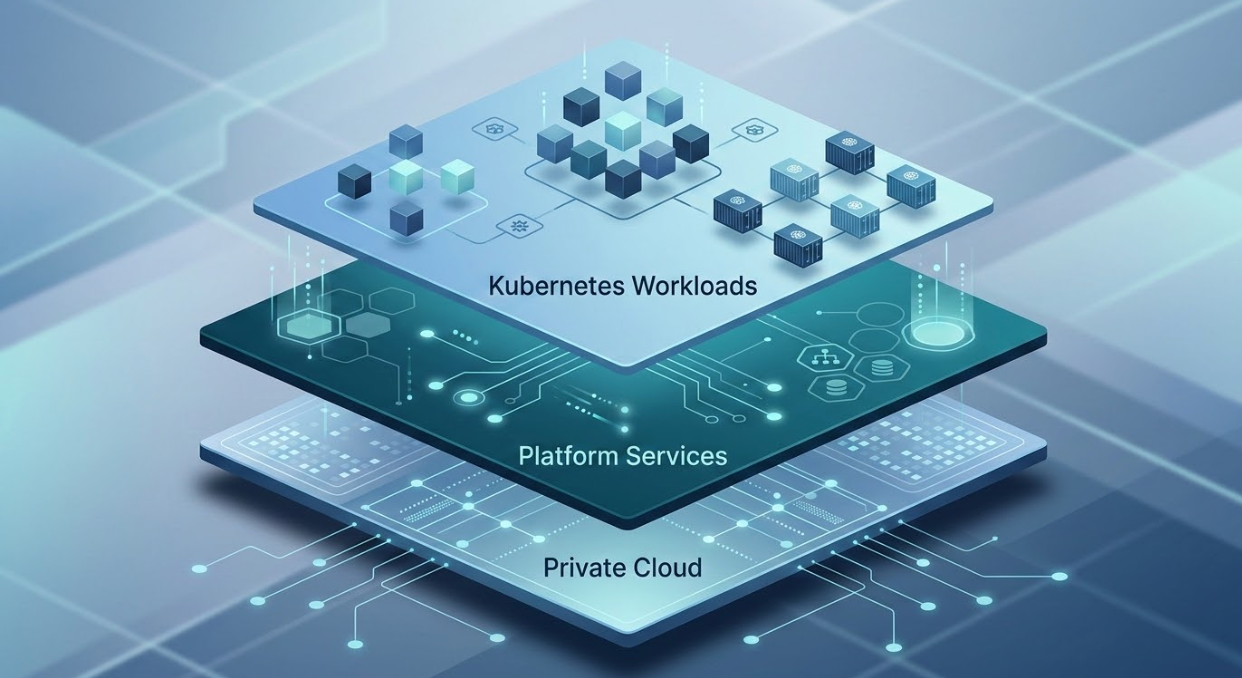

Como mostrado na arquitetura da plataforma acima, a mudança não é apenas sobre o core, é sobre a integração de governança e autoatendimento do desenvolvedor. Se você se afastar das mudanças individuais na versão 1.36, um padrão mais amplo começa a surgir. O Kubernetes está se movendo de um framework flexível para padrões mais opinativos de segurança e recursos. As cargas de trabalho estão se tornando mais complexas. As expectativas operacionais estão aumentando. A margem de erro está diminuindo.

Em conjunto, isso representa uma mudança de Kubernetes como infraestrutura flexível para Kubernetes como uma plataforma que precisa ser projetada, governada e operada com intenção. É aqui que a engenharia de plataforma entra em foco. Na realidade, executar Kubernetes em escala requer mais do que apenas implantar clusters. Requer consistência, guardrails e um modelo claro de como as equipes consomem e operam a plataforma. Esta é também a direção em que temos nos concentrado com o VKS: tratar o Kubernetes não apenas como algo a ser implantado, mas como um serviço que pode ser consistentemente entregue, governado e consumido por equipes e ambientes. A questão então se torna como estruturá-lo de forma a atender consistentemente a essas crescentes expectativas.

O Que Isso Significa na Prática

Para as equipes corporativas, as implicações estão se tornando mais claras. Os desafios destacados no Kubernetes 1.36, seja em relação a cargas de trabalho de IA, expectativas de segurança ou gerenciamento do ciclo de vida, não são coisas que podem ser resolvidas apenas pelo Kubernetes. Eles exigem uma abordagem de plataforma mais ampla que traga estrutura para como o Kubernetes é implantado e operado. É por isso que tanto foco tem sido direcionado para a construção de plataformas que permaneçam alinhadas upstream, ao mesmo tempo em que fornecem a estabilidade, governança e flexibilidade que as empresas precisam na prática. O objetivo é tornar o Kubernetes utilizável em ambientes onde a consistência e o controle importam tanto quanto a inovação.

Olhando Para o Futuro

A evolução contínua do gerenciamento de dispositivos, o endurecimento das expectativas de segurança e a velocidade sustentada de lançamento apontam para um futuro onde o Kubernetes é mais poderoso, mas também mais exigente de operar. As equipes que constroem plataformas hoje precisam projetar sistemas que possam acompanhar a direção do Kubernetes, e fazê-lo de uma forma que equilibre a inovação com as realidades das operações corporativas.

Referências Kubernetes 1.36 Blog Release Notes Saiba mais sobre o vSphere Kubernetes Service Descubra mais no VMware Cloud Foundation (VCF) Blog Assine para receber as últimas postagens em seu e-mail. Digite seu e-mail… Assinar

Como parceira certificada, a VirtuAllIT pode auxiliar sua empresa a navegar por essas complexidades do Kubernetes, oferecendo consultoria especializada e suporte na implementação de soluções que alinham a inovação upstream com as necessidades de estabilidade e segurança do seu ambiente corporativo, garantindo que sua infraestrutura de TI esteja preparada para os desafios futuros.

Precisa de ajuda com suas soluções de TI?

A VirtuAllIT Solutions oferece consultoria especializada em virtualização, cloud computing e infraestrutura tecnológica.